Máy đạo đức - Moral Machine

“Vấn đề xe điện” được Giáo sư Michael Sandel từ đại học Harvard nêu ra để mở đầu cho chuỗi bài giảng nổi tiếng về “Công lý: Đâu là điều đúng để làm” của mình. Cụ thể như sau:

“Hãy tưởng tượng bạn là tài xế của một chiếc xe điện đang chạy trên đường ray với vận tốc 60 dặm/giờ. Trước mặt bạn là năm công nhân đang làm việc trên đường ray với nhiều dụng cụ trên tay. Bạn đang cố gắng dừng xe lại, nhưng không thể và cũng không có cách nào thông báo cho năm công nhân trên. Thắng của xe điện không hoạt động. Bạn đang cảm thấy tuyệt vọng bởi vì chắc chắn một điều rằng khi xe va phải các công nhân trên, tất cả họ sẽ chết. (Giả sử bản biết chắc chắn điều này).

Đột nhiên, bạn phát hiện ra một đường ray phụ nằm ở phía bên phải của đường ray chính và ở đó có một người công nhân khác đang làm việc ở đó, đúng, chỉ có duy nhất một người. Bạn nhận ra rằng bạn có thể bẻ lái chiếc xe và như vậy thay vì giết chết năm người, bạn chỉ giết chết đúng một người.

Hãy hình dung một tình huống khác.

Lần này bạn không phải là người tài xế, mà là một người đang đứng quan sát trên một chiếc cầu vượt bắc qua đường ray xe điện. (Lần này, nhớ là không có đường ray phụ nào cả). Phía dưới đường ray đang có năm công nhân đang làm việc. Một lần nữa thắng xe không hoạt động. Xe chắc chắn sẽ cán chết năm người này. Bạn đang cảm thấy vô vọng vì không làm gì giúp được cho năm người ấy – cho đến khi bạn quan sát thấy đứng bên cạnh bạn trên cầu là một người đàn ông mập mạp rất nặng ký. Bạn có thể đẩy ông ta xuống cầu ngay trên đường ray để chặn chiếc xe lại. Như vậy ông ta sẽ chết để năm công nhân kia được sống. (Bạn cũng suy nghĩ là mình cũng có thể tự nhảy xuống để chặn lại, nhưng vì mình quá nhẹ kí không đủ để dừng chiếc xe).”

Có một câu hỏi hóc búa về đạo đức ở đây. Tại sao hi sinh một người để cứu năm người lại có vẻ hợp lý trong tình huống thứ nhất nhưng lại có vẻ gì đó sai trái trong tình huống thứ hai. Sandel đã lý giải rất chi tiết về “đạo đức” trong tình huống hóc búa trên trên cùng các “case study” thú vị khác, bạn có thể theo dõi toàn bài giảng ở đây (hoàn toàn miễn phí):

Trong bài chia sẻ với chủ đề “Cuộc cách mạng đạo đức” do Emmanuel Lulin – Phó chủ tịch của L’Oreal (Kiêm Giám đốc mảng Đạo Đức Doanh Nghiệp – Chief Ethics Officer) sáng nay ở Hague (trong hội nghị #oyw2018). Emmanuel đã phân tích về tầm quan trọng trong hành vi “đạo đức” doanh nghiệp không hề thua kém với hoạt động mang tính kinh tế hay theo đuổi chất lượng sản phẩm. Ở đây cụ thể là chiến lược đưa “đạo đức/ethics” vào trung tâm trong các hoạt động thường ngày của L’Oreal và cách thức mà nó giúp củng cố niềm tin/trust và sự minh bạch/transparency trong vận hành và nâng cao hiệu suất/productivity doanh nghiệp. Emmanuel cũng nhắc đến một nghiên cứu thực nghiệm thú vị của đại học MIT mang tên “Máy đạo đức” – một nền tảng trực tuyến được phát triển bởi Iyad Rahwan, giáo sư người Úc gốc Syria, một chuyên gia AI sừng sỏ. Qua đó giúp mình kết nối lại được với những hiểu biết về”đạo đức” được giáo sư Sandel từng đề cập.

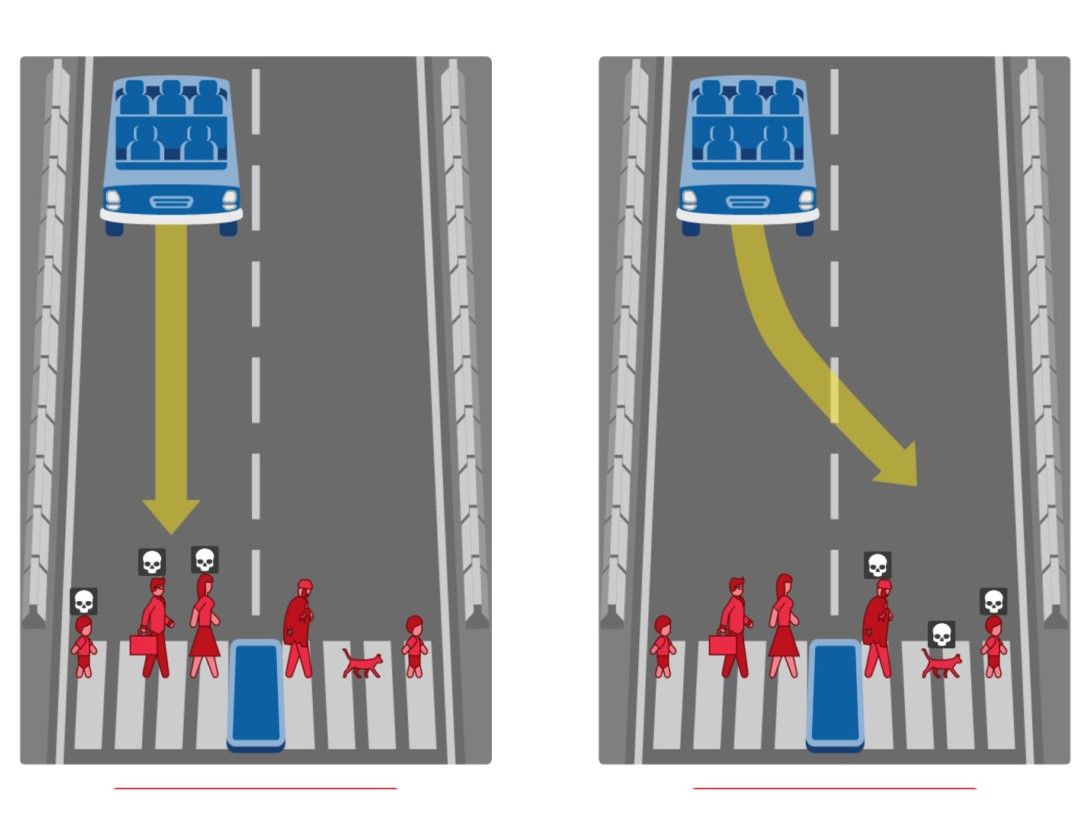

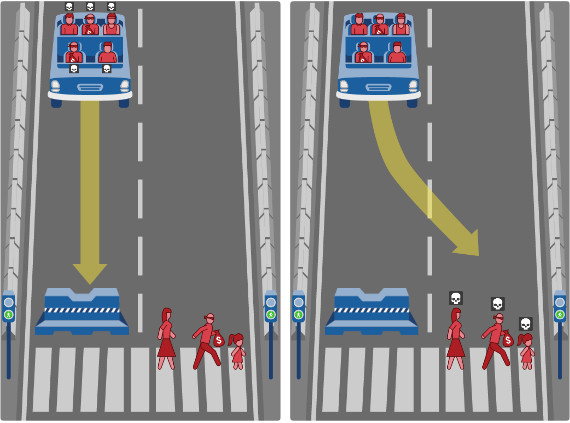

Iyad đang điều hành nhóm nghiên cứu mang tên Scalable Cooperation (SC) với nhiệm vụ tập hợp những tình huống tiến thoái lưỡng nan về mặt đạo đức và nghiên cứu cách con người đưa ra lựa chọn giữa hai kết quả đều mang tính hủy diệt (như ví dụ trên) . Thông tin được SC thu thập trên nền tảng Moral Machine dưới đây - cụ thể người tham gia trả lời các câu hỏi trắc nghiệm tình huống với bối cảnh chủ yếu là về vấn đề của xe điện/trolley problem (như ví dụ của Sandel).

Bạn hãy truy cập và thử làm bài test hóc búa về mặt “đạo đức” của họ, các thông tin thu thập này sẽ được dùng cho nghiên cứu chuyên sâu về việc ra quyết định của “máy thông minh/intelligence machine trong tương lai. Ví dụ cụ thể như khi các xe tự lái phải quyết định giữa sự sống và cái chết trong một tình huống cụ thể trên đường. Các kết quả nghiên cứu AI như thế này sẽ giúp củng cố thuật toán và tối ưu hóa quyết định của xe tự hành hay “máy thông minh”. SC cũng có một thí nghiệm thú vị mang tên DeepMoji trên nền tảng trên, trong đó họ đo lường cảm xúc của người dùng Twitter khi họ đăng tải các dòng tweet của mình – qua đó có thể dạy cho AI hiểu được nội tâm của người dùng. Khoa học máy tính và khoa học xã hội đã giao thoa với nhau, ở đây nhóm SC nghiên cứu về khía cạnh xã hội của trí tuệ nhân tạo AI: khoa học xã hội tính toán (computional social science), trí tuệ tập hợp (collective intelligence), hợp tác diện rộng (large-scale cooperation) – những nghiên cứu “đạo đức” sẽ có ảnh hưởng sâu rộng đến thực tại và tương lai nhân loại.

Comments ()