Tư duy nhanh và chậm, AI và Deep Learning (Học Sâu) [Phần 2]

![Tư duy nhanh và chậm, AI và Deep Learning (Học Sâu) [Phần 2]](https://storage.ghost.io/c/47/0a/470ae594-95d7-4a23-93c6-35e2a8908002/content/images/size/w960/2022/08/alphago.jpg)

[Vật chất tối của trí tuệ]

Trong "Tư duy nhanh và chậm", Daniel đề cập đến hai hình thức tư duy: (1) một cái diễn ra nhanh, dựa trên trực giác, đầy cảm xúc (2) một cái thì chậm hơn, dựa trên logic, trầm tĩnh, đầy cân nhắc. Có thể hình dung hệ thống đầu tiên bao gồm một tập hợp các hoạt động xử lý ý tưởng nhanh (family of activities). Ý tưởng chảy tự động vào trong tâm trí theo nhiều cách khác nhau, như trong ví dụ kinh điển, có cái gì đó hiện ra trong đầu bạn khi nhắc đến bài tính đơn giản 2+2 (hay cái gì hiện ra trong đầu khi nhắc đến ba từ: nước, muối, xanh da trời). Tuy nhiên, trong một số trường hợp, bạn phải nỗ lực làm gì đó để ý tưởng xuất hiện. Khi nâng độ khó lên hai chữ số, ví dụ như 27x14 chẳng hạn, lúc này một loạt các thuật toán (algorithm) chạy trong đầu, gắn kết với trí nhớ ngắn hạn và đòi hỏi bạn phải tập trung để xử lý (gần như không thể làm việc gì khác). Nỗ lực tâm trí (mental effort) là đặc tính quan trọng của hệ thống (2), còn hệ thống (1) thì ngược lại - không tốn sức (effortless). Hai hệ thống này quện xoắn vào nhau, không có sự phân biệt rõ ràng trong tâm trí.

Liên tưởng tới thuyết tiến hóa của Darwin, rõ ràng, hệ thống nhận thức (perceptual system) đã giúp động vật (animal) hiểu biết thế giới, đôi khi chúng có thể đoán được điều gì gần diễn ra xung quanh một cách khó ký giải, đây là năng lực chủ đạo cho sự sinh tồn (liên quan đến hệ thống 1). Hệ thống thứ (2) phát triển trên nền này, bao gồm sự xuất hiện của ngôn ngữ, khả năng xử lý ý tưởng (manipulating ideas), khả năng tưởng tượng về tương lai (imagining futures), khả năng phán đoán những thứ chưa xảy ra (counterfactuals thing), thực hiện các suy tư có điều kiện (conditional thinking). Những điều trên không thể xảy ra nếu chúng ta không có phương tiện ngôn ngữ và bộ não lớn (so với các loài động vật khác).

Hệ thống (1) trông có vẻ gắn với động vật hơn, tuy nhiên cũng có khả năng trò chuyện (talk). Cụ thể, nó có ngôn ngữ, có thể hiểu ngôn ngữ và tham gia vào quá trình giao tiếp thay cho chúng ta. Tất nhiên, hệ thống này không dựa vào một quy trình thận trọng để chọn từng từ ngữ nói ra, mà chỉ đơn giản là một ý tưởng rực sáng trong đầu và ngôn từ tự tuôn ra, hoàn toàn tự động và không hề tốn công sức. Chúng ta cần tin tưởng hệ thống (1) bởi tốc độ xử lý nhanh chóng của nó gắn với bản năng sinh tồn, hãy hình dung cách chúng ta thích nghi với bối cảnh xung quanh khi băng qua đường. Nếu chỉ dựa vào sự chậm chạp của hệ thống (2), sự tồn tại của chúng ta trên hành tinh này sẽ rất ngắn. Cần hiểu rõ, hệ thống (1) không chỉ gắn với bản năng mà còn cả những kĩ năng chúng ta gặt hái được (skilled behavior). Ví dụ như chúng ta không thể tự dưng biết lái xe mà phải đi qua quá trình học hỏi, khi đã thành thục rùi việc lái xe sẽ diễn ra tự động hơn.

Phần lớn thời gian, những gì chúng ta lường trước (anticipation) thường diễn ra rất chính xác. Phần lớn các kế hoạch thường diễn ra đúng ý đồ. Phần lớn mọi thứ xung quanh bạn hoạt động suôn sẻ, đó là nhờ vào vai trò của hệ thống (1), chúng thường hoạt động tốt hơn hệ thống (2). Chất lượng xử lý các vấn đề phức tạp mà ko cần nhiều nỗ lực của hệ thống (1) rất đáng kinh ngạc. Người chơi cờ giỏi thường có những nước đi mạnh mẽ (strong moves) diễn ra trong đầu, thường đến một cách vô tình (unconsciously), tự động và nhanh chóng nhờ hệ thống (1), sau đó được xác thực lại bởi hệ thống (2).

Góc nhìn trên của Daniel liệu có hữu dụng trong việc xây dựng các cỗ máy có hệ thống (1) hiệu quả hay mô hình AI (Trí tuệ nhân tạo) và các robot liên quan. Địa hạt "Deep Learning" (học sâu) hiện tại có vẻ như đang tập trung vào hệ thống (1) hơn là (2), dựa trên một tập các khuôn mẫu (patterns) để phỏng đoán nhưng gì có thể diễn ra (highly predictive). Tuy nhiên, việc xây dựng khả năng phân tích lý lẽ (reason), vốn đóng vai trò cực kỳ quan trọng trong địa hạt "học sâu", vẫn còn gặp nhiều khó khăn. Hệ thống (2) còn rất xa tầm tay bởi mô hình "học sâu" hiện tại chưa mô phỏng được lý luận nguyên nhân - hậu quả (causality) hay có cách nào đó để đại diện cho ý nghĩa (meaning - theo cách con người cảm nhận) hay tương tác thật (real interaction). Dù còn nhiều giới hạn nhưng những gì đạt được hiện tại rất đáng khích lệ.

Hãy quan sát nỗ lực của các học giả với hệ thống (1). DeepMind, dự án bị thâu tóm bởi Google, đã tạo ra mạng nơ ron (neural network) có thể học cách chơi video game như con người và Neural Turing Machine, một mạng nơ ron có thể tiếp cận bộ nhớ ngoài (external memory) như máy Turing truyền thống - khiến máy tính có thể bắt chước bộ nhớ ngắn hạn (short-term memory) của não người. DeepMind cũng tham gia tạo ra những chương trình máy tính có thể chơi cờ vua (chess) và cờ vây (go) ngang ngửa hay vượt trội hơn so với các kỳ thủ - đi từ AlphaGo (cờ vây) đến AlphaGo Zero (có thể tự học cách chơi), rồi AlphaZero (có thể chơi nhiều trò chơi khác như cờ vua (chess) và cờ shogi). AlphaZero sau đó được tiếp nối bởi MuZero, chương trình có thể tự học cách chơi mà không cần nói trước luật (without being taught the rules). Tuy nhiên, việc chạm đến khu vực bí ẩn "năng lực duy lý" của con người (reasoning) vẫn còn nhiều thách thức. Nhà tâm lý học Gary Marcus, người nghiên cứu chuyên sâu về ngôn ngữ (language) và tâm trí (mind), đã nhận định: "con người học rất nhanh, trẻ em không cần cả triệu ví dụ mà chỉ cần hai ba ví dụ là đã có thể nhìn nhận ra vấn đề. Đó là sự khác biệt cơ bản, bởi hiện tại vẫn phải xây dựng bên trong máy móc một cái gì đó, kiểu như rất nhiều kỳ vọng (rất nhiều dữ liệu) để chúng có thể học." Chính vì vậy, Marcus chỉ trích việc sử dụng khối lượng lớn dữ liệu để xây dựng các hệ thống AI, cụ thể: "nếu muốn xây dựng hệ thống AI, chúng ta cần học điều gì đó từ con người, cụ thể là cách họ suy tư duy lý (reason), khám phá thế giới vật lý, cách họ nắm bắt ngôn ngữ và các khái niệm phức tạp". Marcus có viết một cuốn sách rất thú vị: "Sự ra đời của trí não" (the birth of mind) trong đó mô tả chi tiết cách thức hệ thống gene tác động đến suy tư của con người (human thought) - làm thế nào một nhúm nhỏ gene lại tạo ra sự phức tạp của não bộ con người. Đây là điều mà có lẽ nằm trong bàn tay của "Thượng Đế".

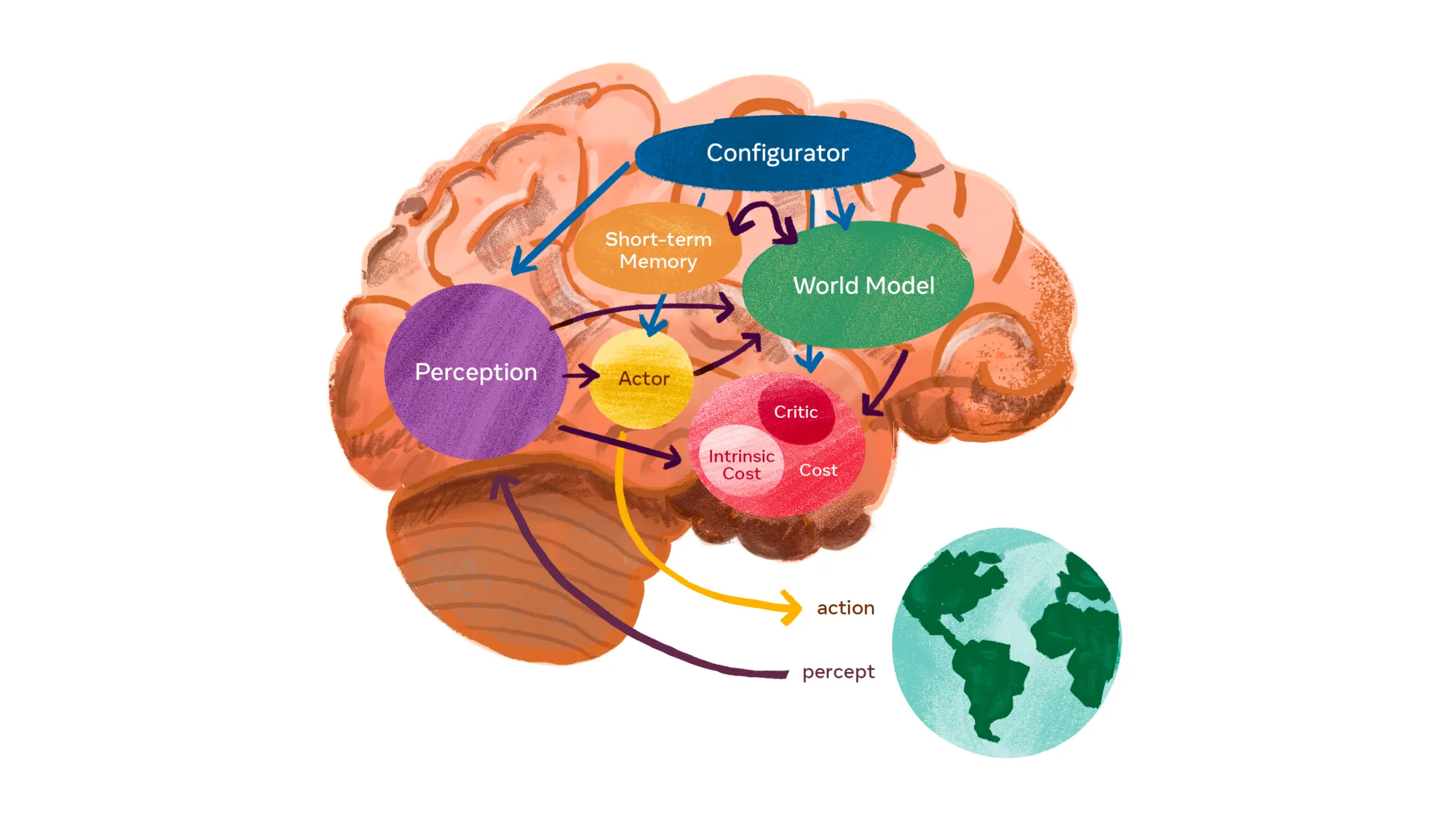

Nhiều học giả đang cố gắng sử dụng mạng nơ ron (neural networks) để mô phỏng quá trình duy lý (reason) và thu thập kiến thức (assemble knowledge) của con người. Tuy nhiên, việc đưa năng lực phân tích nhân - quả (temporal causality) vào máy vẫn còn ở rất xa (out of reach). Điển hình như cách địa hạt AI loay hoay tìm cách mô phỏng khả năng "duy lý về đạo đức" (moral reasoning) nhưng mức độ thành công còn khá khiêm tốn, có lẽ chúng ta đã chạm đến một giới hạn nào đó. Ẩn sâu trong hệ thống (1) chính là một mô hình về thế giới để chúng ta phản ứng để đảm bảo sự sinh tồn (đi kèm một số kĩ năng học được), siêu thách thức để xây dựng (có lẽ việc này chỉ dành cho Thượng Đế).

Nhà khoa học máy tính Pháp, Yann LeCun, hiện đang phụ trách mảng AI cho Meta (Facebook), không cho rằng chúng ta đã vấp phải các giới hạn. Khả năng nhận biết các khuôn mẫu (pattern matching/recognition) trong mạng lưới nơ ron (neural networks) mà Yann đang nghiên cứu đang trông giông giống hệ thống (2) mà Daniel đề cập. Chúng ta vẫn có thể thúc đẩy các nghiên cứu AI mà không đối diện với những thay đổi lớn về mặt kiến trúc. Tuy nhiên, Yann thừa nhận, nút thắt cổ chai hiện tại trong địa hạt AI chính là "học có giám sát" (supervised learning) - hay sử dụng tập dữ liệu có dán nhãn để học, nó hạn chế việc xây dựng các mô hình AI có thể làm được nhiều việc (multiple tasks) và học hỏi kĩ năng mới mà không cần đến lượng lớn dữ liệu có dán nhãn (labeled data). Về mặt thực tiễn, làm sao chúng ta có thể dán nhãn hết mọi thứ trên thế giới này. Những đứa bé đơn giản chỉ học hỏi về thế giới thông qua quan sát. Con người lúc nhỏ tự hình thành các mô hình tiên đoán (predictive models) về các vật thể xung quanh (objects). Rồi khi lớn lên, lại tiếp tục quan sát, xây dựng một số giả thiết về cách thức hành động để thay đổi môi trường qua quá trình thử - sai (trial and error). Kiến thức tổng quan về thế giới (generalized knowledge hay còn gọi common sense) góp phần xây dựng nên "trí tuệ sinh học" (biological intelligence) cho cả con người và động vật. Khái niệm "common sense" (thường dịch là lẽ thường) chính là vật chất tối (dark matter - ám chỉ cái gì đó khó nắm bắt) của ngành AI, thứ mà nhờ đó con người học được những kĩ năng mới mà không phải hấp thụ quá nhiều bài giảng (massive amounts of teaching). Dù vậy, Yann vẫn tin việc áp dụng mô hình SSL (self supervised learning - học tự giám sát) là cách thức hiệu quả để tạo ra "common sense" cho hệ thống AI.

Tất nhiên, thành tựu trên vẫn còn xa mới tiệm cận đến mô hình học phi giám sát - khả năng học mà không cần đến lượng dữ liệu dán nhãn (unsupervised learning). Kiến trúc mạng nơ ron (neural networks) hiện tại có lẽ chỉ mới chạm đến một phần năng lực duy lý (reason) và phân tích nhân quả (causality). Yann rất thực tế: "chúng ta chỉ có thể nhìn thấy một hay hai đỉnh núi đằng trước nhưng có vẻ còn nhiều đỉnh núi khác sau đó". Khả năng nhận biết các khuôn mẫu (pattern matching) có nhiều ứng dụng trong thực tiễn. Cụ thể như mạng nơ ron giúp xử lý thông tin một cách tuần tự (sequentially) có thể áp dụng vào quá trình dịch thuật tự động, tuy nhiên bản thân "cỗ máy dịch thuật" đó vẫn không thực sự hiểu mình đang nói gì. Chúng ta đang trong quá trình tìm kiếm AI có cảm giác (Sensation), AI có thể kết nối với thế giới thật (in touch), hay AI có thể phản ánh nhận thức thật sự (consciousness kind) - kiểu như nhận biết điều gì đang diễn ra xung quanh, hiểu được ngôn từ, và gắn kết với nhận biết (perception) và hành động cụ thể (action). Yann đã tiên phong xây dựng nền tảng (ground) cho địa hạt AI trong không gian vật lý (physical space). Nếu không có "nền tảng" (ground) này, một cỗ máy sẽ không thể hiểu nó đang nói cái gì, hay có thể suy tư như con người (human-centric thinking) và tìm kiếm ý nghĩa cho sự tồn tại của nó. Cỗ máy này có thể cần có một cơ thể hay có một số giới hạn (finiteness) như con người.

Tất nhiên, ngoài cơ thể ra (có thể có ích nếu mô phỏng máy như người), cần có hệ thống nhận thức (perceptual system) hướng về trung tâm cỗ máy (central) giúp thu thấp kiến thức về thế giới. Có những người cơ thể bị liệt (paralyzed) nhưng trí tuệ của họ vẫn siêu việt (như Stephen Hawking) thì việc một cỗ máy có thể làm điều tương tự thực sự là một bứt phá lớn. Cũng như Yann, Daniel cũng quan sát trẻ em, cụ thể là cách chúng chơi đùa với thế giới. Trẻ em có một năng lực học hỏi chủ động (active learning), hoàn thiện hệ thống (1) và (2) để hòa vào môi trường xung quanh. Hãy nhìn cách đứa bé điều khiển bàn tay của mình - có gì đó kết nối chuyển động đôi tay với não bộ, rồi từ đó não bộ thu nhặt những khuôn mẫu mới (patterns). Đây cũng là thành tựu mà chúng ta đã đạt được với chân tay nhân tạo (artificial limbs), người khuyết tật có thể kết nối với thiết bị này và học cách thích nghi rất nhanh. Rõ ràng, chúng ta đã có một số hệ thống sẵn sàng học hỏi các phản ứng từ thế giới. Tất nhiên, vùng đất bí ẩn AI còn nhiều điều phải khai phá.

Có một ứng dụng thực tế của AI (mà Lex tham gia nghiên cứu) là xây dựng xe tự hành (autonomous vehicle), trong đó các học giả đang cố gắng mô hình hóa phản ứng của khách bộ hành (pedestrians) để tiên đoán: "liệu họ có bước qua đường hay không?". Trong mô hình này, khối lượng lớn thông tin mà mỗi phương tiện có được sẽ chảy vào một hệ thống xử lý khổng lồ khác. Nói cách khác, mỗi phương tiện khi học được điều gì đó mới, thì cả hệ thống cũng ghi nhận cái mới đó. Với lượng thông tin tăng có thể theo cấp số nhân như vậy, có nhiều kết quả có thể đúc kết - cụ thể việc phán đoán "khách bộ hành" sẽ có độ chính xác nhất định. Tuy nhiên, cần chân nhận, con người rất phức tạp và hệ thống cũng có thể mắc lỗi (như cách con người mắc lỗi). Mỗi bối cảnh lại rất khác nhau như khi đi qua bùng binh, hay rơi vào kẹt xe (như ở Việt Nam), hoặc khi có người lao qua đường bất chấp.

Lex thừa nhận, hiện tại "khách bộ hành" trong mô hình vẫn được xem như vật cản (không thể che dấu) của xe bộ hành thay vì một đại diện (agents) để tương tác trong trò chơi AI (về mặt lý thuyết). Rất khó để đoán định điệu nhảy (dance) giữa tài xế - khách bộ hành. Daniel mô tả: "rất phức tạp, khi tôi bước qua đường và có phương tiện đang hướng đến, đầu tiên tôi sẽ nhìn vào mắt tài xế, điều mà có lẽ nhiều người cũng làm, để gửi tín hiệu dừng xe. Họ có thể hiểu ngay là tôi muốn băng qua đường. Hy vọng xe tự lái có thể nắm bắt tín hiệu từ mắt tôi tốt hơn. Và khi băng qua đường, bạn không hề nhìn lại, băng băng đi vì tin tưởng tuyệt đối rằng phương tiện kia sẽ không tông vào mình. Trông giống như trò chơi con gà (game of chicken - trò chơi mà hai người chơi đối đầu nhau trên một con đường hẹp theo kiểu “dê đen dê trắng”)." Daniel cho rằng không cần phải cố gắng xây dựng mô hình giống như "trí não con người" để giải quyết bài toán va chạm phải khách bộ hành (kiểu như xe tự hành phải có năng lực quan sát để đoán định khả năng gây chết người). Thực ra, đôi khi, không nhất thiết phải có quá nhiều hiểu biết (zero understanding) để đoán định (anticipate) điều gì đó, kiểu như trực giác khi chơi cờ vây hay cờ vua. Nếu không nhận rõ điều này, nỗ lực xây dựng mô hình sẽ bị mắc kẹt.

Comments ()